Nell’odierno mondo connesso digitalmente, la messaggistica politica e la disinformazione stanno diventando sempre più sofisticate. Le campagne politiche e gli sforzi di disinformazione, in particolare quelli ben finanziati, hanno un impatto significativo sulla società. Esse hanno storicamente sfruttato i punti di vista politici e ideologici per entrare in sintonia con le persone, convincerle ad agire o addirittura attirarle in una truffa.

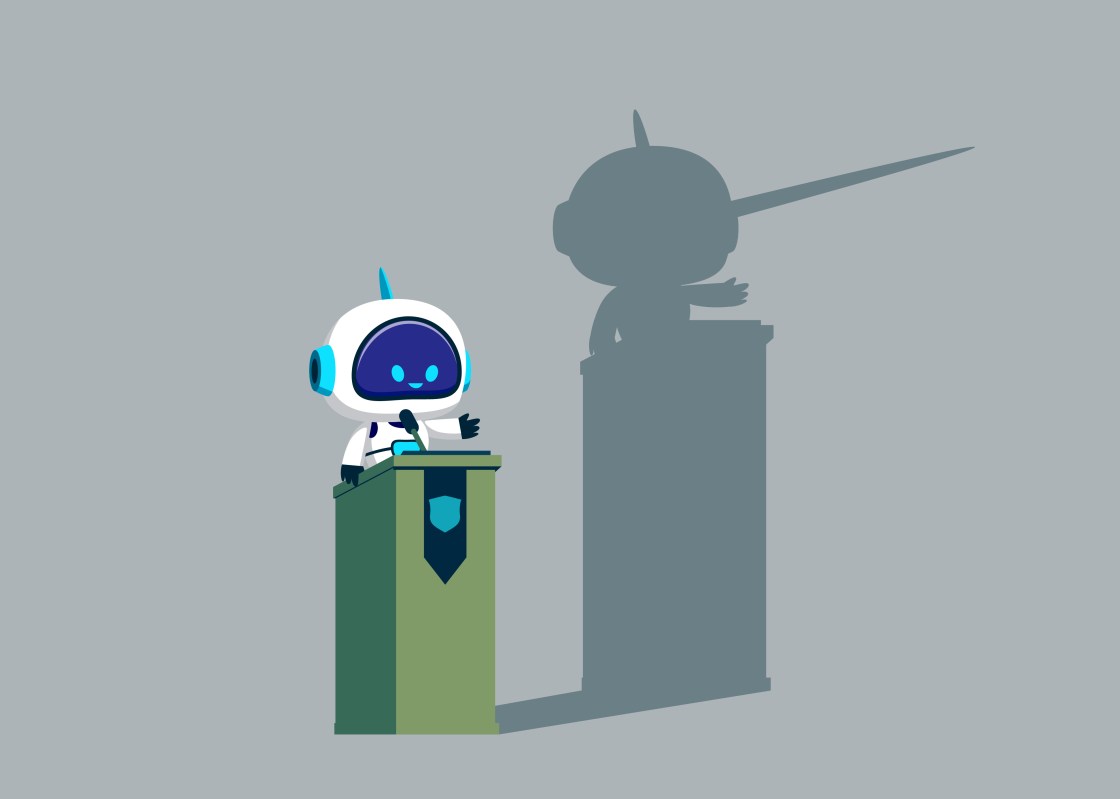

Le tecnologie di IA generativa, come i modelli linguistici di grandi dimensioni (LLM) e i modelli di immagini di grandi dimensioni, probabilmente trasformeranno questo settore. L’IA generativa offre strumenti per la creazione di contenuti sofisticati e personalizzati su larga scala, che in precedenza erano difficili e richiedevano molto lavoro. Con queste capacità, il rischio rappresentato da soggetti malintenzionati può raggiungere nuovi livelli.

Abbiamo già osservato una serie di soggetti che abusano dell’IA generativa nell’ambito di campagne di frode in corso, tra cui l’uso di testi generativi per inviare messaggi alle vittime di truffe, immagini generate dall’IA per creare social media ingannevoli e video e voci “deepfake” creati dall’IA per favorire l’ingegneria sociale delle vittime. Questi stessi strumenti sono stati utilizzati come parte di campagne di disinformazione e frode politica sui social media.

Data la rilevanza di questi argomenti a fronte delle elezioni in corso in tutto il mondo, la comprensione dell’effetto delle nuove tecnologie sulla disinformazione politica è particolarmente importante. In questa analisi, esploriamo una delle maggiori minacce emergenti dall’uso malevolo dell’IA generativa: la disinformazione su commissione. Se qualcuno include una disinformazione intenzionale in un’e-mail di massa, le persone che non sono d’accordo saranno allontanate dalla campagna. Ma nel metodo che abbiamo esplorato nella nostra ricerca, la disinformazione viene aggiunta all’e-mail solo quando è probabile che quella specifica persona sia d’accordo con essa. Questa possibilità può cambiare completamente la scala di propagazione dei messaggi di disinformazione.

Nella ricerca che documentiamo in questo rapporto, abbiamo cercato di scoprire i potenziali metodi con cui gli avversari potrebbero applicare gli strumenti di IA generativa per apportare cambiamenti d’impatto nella sfera politica. Questi metodi utilizzano le attuali tecnologie di IA generativa in un modo che può essere eseguito a costi molto bassi da un’ampia gamma di potenziali attori che desiderano influenzare la politica su piccola o larga scala.

Leggi tutto l’articolo.