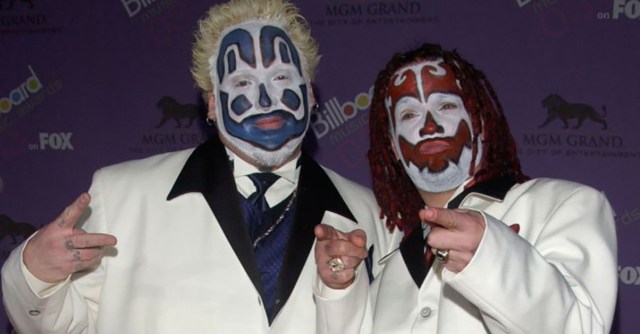

Ce week-end, un blogueur pour le compte de WonderHowTo, connu sur Twitter sous le pseudonyme de @tahkion, a annoncé que le maquillage des fans du duo de hip-hop Insane Clown Posse (ICP), connu sous le nom de Juggalos ou Juggalettes, compliquait grandement l’identification du porteur par le logiciel de reconnaissance faciale (RF).

i made a breakthrough. it turns out juggalo makeup defeats facial recognition successfully. if you want to avoid surveillance, become a juggalo i guess pic.twitter.com/kEh7fUQeXq

— TAHKION (@tahkion) 1 juillet 2018

Tahkion dit qu’il a découvert cette ruse tout en travaillant sur son propre projet de recherche en reconnaissance faciale et a été assez surpris de constater que le maquillage du visage de Juggalo était :

Un des camouflages les plus efficaces que j’ai trouvés, encore plus efficaces que certains styles créés délibérément pour duper de tels systèmes.

Bien sûr, alors que la peinture faciale de Juggalo peut tromper la reconnaissance faciale automatique (RFA), elle rend le porteur bien plus reconnaissable que n’importe qui d’autre, à savoir parmi les humains, a déclaré Tahkion. Pour ceux qui sont vraiment motivés pour déjouer la reconnaissance faciale, ce n’est pas la solution. Au contraire, les allergiques à la surveillance constante devrait plutôt opter pour un déguisement anti-reconnaissance faciale qui passerait complètement inaperçu pour l’œil humain.

La reconnaissance faciale se base sur les distances entre différents points précis placés sur le visage. Même si le maquillage de Juggalo est parvenu à “imiter” ou à remplacer ces points de repère, ce changement est extrêmement visible. Idéalement, on devrait utiliser du maquillage ou des masques pour pouvoir transformer des parties significatives du visage, la mâchoire, le nez et les yeux plus particulièrement. Il n’existe pas vraiment une méthode ayant déjà fait ses preuves, mais c’est certainement le chemin que ces techniques de contournement de la RF vont emprunter à l’avenir.

Il y a eu beaucoup de tentatives pour déjouer la technologie de reconnaissance faciale au cours de ces dernières années, que ce soit le maquillage ou des coupes de cheveux à la CV Dazzle, des vêtements faits de verres réfléchissants type nanosphère qui anéantissent les efforts du flash photo en transformant le porteur en une “photo-bombe thermonucléaire”!, des T-shirts effrayants imprimés affichant des ressemblances avec des célébrités déformées et conçues pour mettre en échec cette technologie, et diverses variantes de la visière spéciale vie privée : à savoir une feuille de plastique enveloppante et semi-transparente placée sur les montures de lunettes.

Tahkion a noté que le maquillage de Juggalo, à savoir un masque de clown noir et blanc très contrasté, a réussi là où d’autres techniques plus subtiles de contournement de la reconnaissance faciale ont échoué, car elles se basaient sur une mâchoire radicalement redessinée.

for anyone wondering why some face changes evade facial recognition and others don’t, here’s a visualization of how landmarks are placed on a few examples. juggalo makeup is particularly effective as it basically totally redefines what is interpreted as the jawline pic.twitter.com/dFSx5FEGc9

— TAHKION (@tahkion) 1 juillet 2018

Comme vous pouvez le voir, le maquillage de Juggalo consiste généralement à mettre sur le visage de la peinture sombre, plus particulièrement sous la bouche, et à s’arrêter avant qu’elle n’atteigne le menton, ce qui réduira considérablement la capacité du logiciel de reconnaissance faciale automatique à localiser la mâchoire de la personne.

Les commentateurs ont suggéré que le maquillage de Juggalo ne parviendrait à tromper uniquement “un logiciel vraiment, vraiment stupide”, mais que des humains pourraient facilement en regardant un tel visage se dire que oui, effectivement, il existe bien une mâchoire sous la peinture du visage. Cela n’a pas de sens, a déclaré Tahkion.

La puissance de la technologie de reconnaissance faciale est qu’elle est automatisée et qu’elle peut parcourir des centaines de milliers de visages et leur donner instantanément des identités. Il a expliqué que la RFA basée sur les réseaux neuronaux est entrainée avec des niveaux de contraste sur des repères faciaux normaux, par exemple, où se trouve un nez, où le menton débouche sur le cou. Cela signifie que “vous devez soit avoir un utilisateur qui définit les points de repère manuellement ou bien entraîner un réseau tout simplement sur la peinture du visage de Juggalo”.

i don’t know why i’m replying to this with a serious answer, but to summarize it’s because the neural network is trained on contrast levels on normal facial landmarks. you would need to either have a user set the landmarks manually or train a network just on juggalo facepaint

— TAHKION (@tahkion) 1 juillet 2018

La RFA est déjà largement utilisée par les forces de l’ordre : la semaine dernière, le FBI a utilisé cette technologie pour identifier le suspect qui aurait ouvert le feu dans les bureaux du journal du Maryland Capital Gazette, tuant cinq journalistes.

Alors qu’il est facilement compréhensible que les forces de l’ordre dans le monde entier adoptent avec empressement la technologie de RFA, les défenseurs des droits civiques appellent à la prudence et à la réglementation autour de son utilisation massive.

Aux États-Unis, par exemple, le FBI détient les portraits de près de la moitié de la population dans une énorme base de données depuis mars 2017, bien que les législateurs l’aient copieusement critiqué pour l’avoir fait illégalement, et sans réglementation. Les photos proviennent de clichés anthropométriques civiles et criminelles, de bases de données de visas et de passeports du Département d’État, de la base de données biométriques du Département de la Défense et des bases de données de permis de conduire de 18 États.

La portée de la base de données, et le fait qu’elle ne soit pas réglementée, signifie que près de la moitié des Américains sont dans une base de données de reconnaissance faciale à laquelle le FBI peut accéder sans mandat ou sans même avoir à prouver qu’ils soupçonnent les intéressés d’être coupables de quoi que ce soit.

Tout cela, malgré le fait que la RFA se trompe souvent et identifie parfois les mauvaises personnes.

Des études ont montré que les visages noirs sont ciblés de façon disproportionnée par la reconnaissance faciale. Selon une étude du Center for Privacy and Technology de l’Université de Georgetown, dans certains États, les Noirs américains sont arrêtés jusqu’à trois fois que le nombre qu’ils représentent dans la population, signifiant qu’ils sont surreprésentés dans les bases de données. Et tout comme les Afro-Américains sont surreprésentés, les erreurs d’identification sont également nombreuses. Ajoutant à cela que les algorithmes utilisés par la technologie de RF sont connus pour être moins précis lors de l’identification de visages noirs.

Lors d’une audience du comité de surveillance de la Chambre en mars 2017, il est apparu que 80% des personnes dans la base de données n’avaient jamais fait l’objet d’une arrestation. Pourtant, l’algorithme de reconnaissance du système les identifie de manière inexacte lors de recherches criminelles dans 15% des cas, les femmes noires étant le plus souvent confondues.

Bien que la RFA fasse des erreurs, la police du Maryland est convaincue que la technologie l’a aidée à identifier le suspect dans les meurtres de Capital Gazette. Tim Altomare, chef de la police du comté d’Anne Arundel, lors d’une conférence de presse le 29 juin :

Nous aurions eu besoin de beaucoup plus de temps pour identifier et être en mesure de faire avancer cette enquête sans ce système.

Le suspect ne portait pas d’identification lorsqu’il a été appréhendé. Les premières tentatives d’utilisation des empreintes digitales n’ont pas fonctionné, compte tenu d’un “décalage” dans le système informatique, a indiqué M. Altomare. La police a trouvé une ressemblance après avoir entré l’image du suspect dans le Maryland Image Repository System (MIRS), qui compare des photos à des millions de photos de permis de conduire et anthropométriques. Mais certains se demandent si l’utilisation de la RFA est bien nécessaire dans un tel cas.

Le suspect, Jarrod Ramos, 38 ans, aurait envoyé trois lettres menaçant de tuer “toute personne présente” : une à un avocat, une à la Cour d’appel spéciale du Maryland et une à un juge de la ville de Baltimore, selon The Baltimore Sun. La police a dit au Sun que les lettres avaient l’adresse de retour de Ramos au dos. CNET a cité Neema Singh Guliani, conseiller législatif de l’ACLU :

Il est extrêmement contestable que la police ait réellement eu besoin d’une technologie de reconnaissance faciale pour identifier ce tireur, qui avait lancé plusieurs menaces au préalable, avait été en garde à vue et avait déjà ses empreintes digitales enregistrées. Le public a droit à plus de réponses et à un débat éclairé avant d’acquérir ou d’utiliser des technologies de surveillance de masse, comme la reconnaissance faciale.

Selon un rapport national du Center on Privacy & Technology de l’Université de Georgetown, le Maryland possède une politique de reconnaissance faciale parmi les plus agressives du pays : la police du Maryland peut rechercher 7 millions de photos de permis de conduire, 3 millions de photos d’identité judiciaire d’état et 24,9 millions de photos anthropométriques au sein de la base de données du FBI.

En 2016, l’ACLU a accusé l’État d’utiliser MIRS sans mandat pour identifier des manifestants à Baltimore après la mort de Freddie Gray alors qu’il était en garde à vue … ce qui nous ramène directement à l’utilisation du maquillage anti-RFA de Jaffgalo. En septembre, les Juggalos ont marché sur Washington dans le but d’attirer l’attention sur le rapport Gang Task Force de 2011 du FBI qui qualifiait les fans de “gang hybride vaguement organisé”.

Les manifestants, dont beaucoup portaient des maquillages qui pourraient à présent empêcher l’identification des manifestants et des suspects par la police, ont affirmé qu’une telle étiquette avait eu un “effet dévastateur” sur la vie des Juggalos, allant du refus de service militaire à la perte de la garde des enfants en passant par, la conséquence la plus fréquente, l’ajout à une liste de gangs locaux et/ou d’état pour le simple fait de porter des produits ou des tatouages liés à Juggalo”.

Clairement, les contours de la reconnaissance faciale sont dessinés plus clairement jour après jour, au sens propre comme au figuré : la police prétend utiliser la RFA pour appréhender rapidement des suspects, alors que les manifestants dessinent littéralement des lignes sur leur visage pour duper cette technologie de surveillance utilisée par la police. Lectrices, lecteurs, de quel côté vous vous situez ?

Billet inspiré de Want to beat facial recognition? Join the Insane Clown Posse, sur Sophos nakedsecurity.